- Publicado

En la transparencia confiamos.

"Un grupo de humanos detrás de un cristal transparente rodeado de robots policiales" por Salvador Dali (DALL-E)

- La transparencia en los sistemas de IA

- La transparencia en los sistemas de diagnóstico médicos

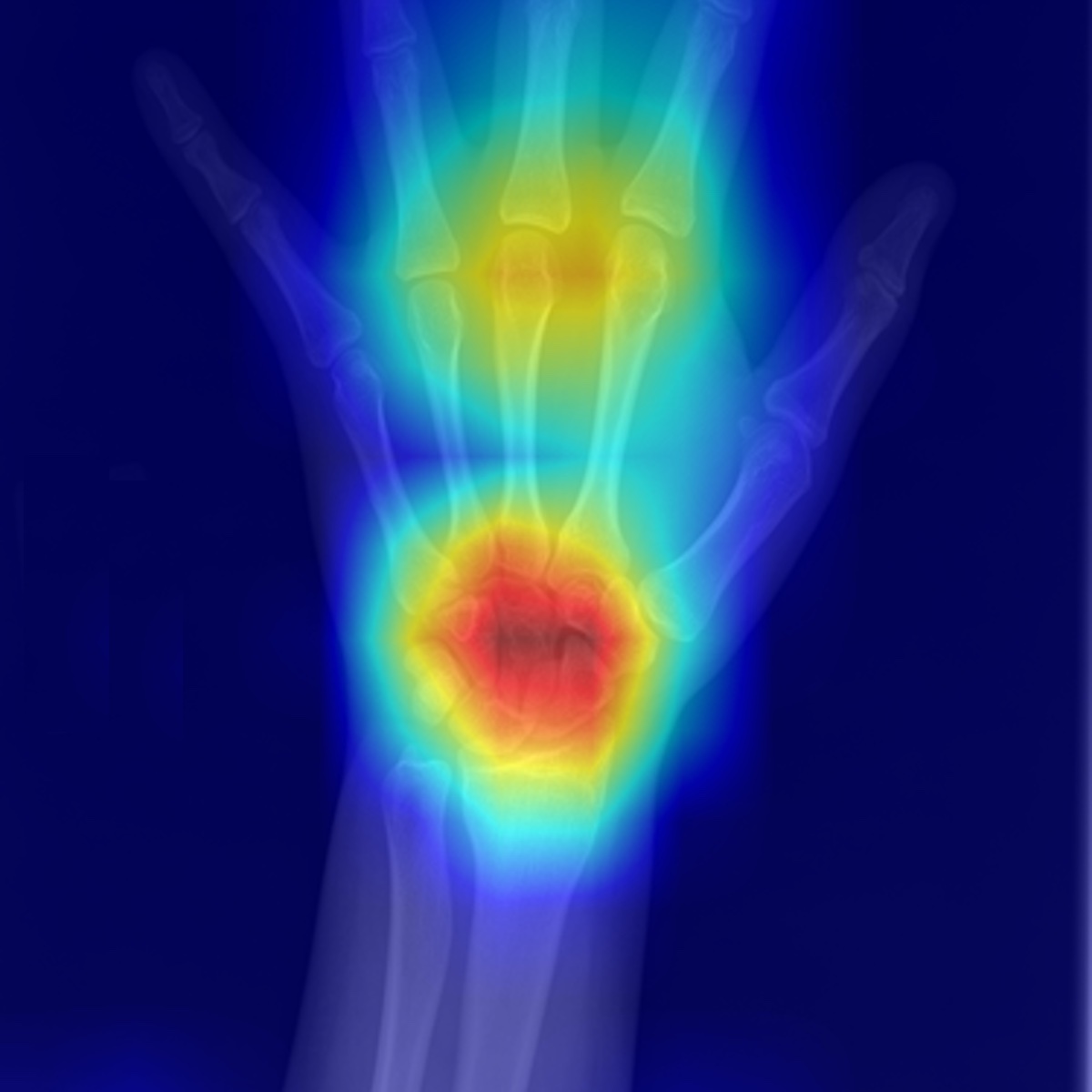

- Explicabilidad: Mapa de Calor

Sea honesto acerca de sus errores. Sea abierto acerca de sus éxitos. Sea transparente para compartir ambos.

La transparencia en los sistemas de IA

“La confianza, la honestidad, la humildad, la transparencia y la responsabilidad son los componentes básicos de una reputación positiva”. Esta cita se le atribuye a Mike Paul quien, según Wikipedia, fue un lanzador zurdo de la MLB que jugó de 1968 a 1974 para los Indios de Cleveland, los Rangers de Texas y los Cachorros de Chicago. ¿Necesitan los algoritmos de IA reputación?

"Un grupo de humanos detrás de un cristal transparente rodeado de robots policiales" por Salvador Dali (DALL-E)

La transparencia en los sistemas de IA hace referencia a la capacidad de los usuarios de un sistema para comprender cómo funciona, incluida la forma en la que el sistema toma decisiones y llega a conclusiones. Esto es importante porque permite que las partes interesadas confíen en el sistema, y garantiza que este se utilice de forma ética y en consonancia con los objetivos legítimos. Un sistema de IA transparente también permite una mejor rendición de cuentas y puede ayudar a identificar posibles sesgos o errores en los algoritmos del sistema. En general, la transparencia se considera un aspecto clave de la IA responsable y confiable.

La transparencia en los sistemas de diagnóstico médicos

La transparencia es particularmente importante en los sistemas inteligentes de ayuda al diagnóstico médico. Primero, los diagnósticos médicos precisos y confiables son cruciales para la salud y el bienestar del paciente. Si un sistema de diagnóstico no es transparente, médicos y pacientes difícilmente confiarían en sus recomendaciones. En segundo lugar, la transparencia puede ayudar a identificar posibles sesgos o errores en los algoritmos del sistema de diagnóstico, lo que es especialmente importante en el campo de la medicina, donde incluso los errores más pequeños pueden tener consecuencias graves. Finalmente, la transparencia es importante por razones éticas. En el campo médico, las decisiones tomadas por los sistemas de IA pueden tener implicaciones de vida o muerte, y es importante que estas decisiones se tomen de manerarazonada, responsable y transparente.

"Un grupo de humanos detrás de un cristal transparente rodeado de robots policiales" por Salvador Dali (DALL-E)

Habiendo establecido el valor de la transparencia para la credibilidad de los sistemas de IA, ¿cómo esta podría manifestarse? A continuación el lector encontrará cuatro formas específicas en las que un sistema podría ser transparente:

- Explicable: se refiere al uso de técnicas de IA que pueden proporcionar explicaciones interpretables y comprensibles por humanos sobre sus decisiones. Por ejemplo, un sistema de IA que utiliza el aprendizaje automático para diagnosticar una enfermedad debería identificar o resaltar los síntomas o factores que consideró más importantes al hacer su recomendación.

- Auditable: se refiere a la capacidad de rastrear los pasos que siguió un sistema de IA para llegar a una conclusión, lo que permite a los usuarios del sistema verificar su precisión y determinar si se produjeron errores o sesgos. Por ejemplo, un sistema de diagnóstico de IA podría proporcionar un registro detallado de los datos que utilizó, los algoritmos que aplicó y el razonamiento detrás de su recomendación.

- Control del usuario: se refiere a la capacidad de los usuarios (e.g. médicos, pacientes, etc.) para personalizar y controlar el comportamiento de un sistema de IA. Por ejemplo, un sistema de diagnóstico podría permitir a los usuarios ajustar la importancia relativa de diferentes factores, o proporcionar información adicional que el sistema podría no haber considerado.

- Apertura y transparencia: Se refiere a la disponibilidad de información sobre el sistema de IA y a cómo este funciona. Por ejemplo, un sistema de diagnóstico podría proporcionar documentación detallada de algoritmos, fuentes de datos y métricas de rendimiento, lo que permitiría a las partes interesadas comprender sus fortalezas y limitaciones.

Explicabilidad: Mapa de Calor

En nuestra aplicación proporcionamos un mecanismo de explicabilidad conocido genéricamente como mapa de calor. Un mapa de calor es una representación visual de los datos de entrada (p. ej., una imagen de rayos X) donde los valores individuales representan la importancia relativa de cada entrada (p. ej., un píxel, región o área de la imagen) en la decisión de la red. Esto puede ayudar a explicar cómo la red interpreta, procesa y usa la información de entrada para hacer predicciones. Un mapa de calor puede mostrar que ciertas entradas tienen una gran influencia en la salida del modelo, mientras que otras tienen una influencia más débil. Así, es posible identificar qué entradas son las más importantes en las predicciones del modelo, y cuáles tienen menos valor o se pueden ignorar. En general, los mapas de calor proporcionan una representación visual útil sobre el funcionamiento de un modelo de aprendizaje profundo.

"Mapa de calor destacando areas de interes" (AZYRI.com)

Los mapas de calor pueden proporcionar confianza a un ojo clínico experto (auditable), pueden ayudar a explicar una decisión a un profesional no especialista (explicable), pueden revelar o identificar síntomas que un ojo humano experto podría pasar por alto (aumentar la inteligencia) o podría simplemente exponer deficiencias o sesgos del sistema inteligente (reconocimiento de las limitaciones del sistema). Los mapas de calor generan transparencia.

Todavía queda un largo camino por recorrer para dotar a los sistemas de IA del superpoder de la transparencia. La ayuda está en camino.